在电商行业 “高并发、快迭代、多场景” 的业务特性驱动下,微服务架构已成为 ZKmall 开源商城突破单体架构瓶颈的核心选择。然而,随着服务数量从 10 个扩容至 50 个、日均调用量突破 1500 万次,传统微服务架构逐渐暴露出 “治理分散、性能不足、云原生适配滞后” 三大痛点 —— 多服务调用链路混乱导致故障排查耗时超 2 小时,Spring Boot2.x 在大促期间接口响应延迟达 500ms,且传统服务治理方案与 Kubernetes 容器平台兼容性差,严重制约业务增长。

为解决上述问题,ZKmall 以 “服务网格(Istio)” 重构服务治理体系,同步完成 Spring Boot3 升级,构建 “治理零侵入、性能倍提升、云原生适配” 的微服务技术架构。本文将结合电商实际业务场景,从技术痛点、实践路径、协同价值三方面,拆解 ZKmall 的微服务创新方案,为同类电商平台提供可落地的技术参考。

一、微服务架构的 “三大核心痛点”:传统方案为何失灵?

ZKmall 在微服务落地初期采用 “Spring Boot2.x+Spring Cloud Netflix” 架构,随着业务规模扩大,传统方案的局限性逐渐凸显,具体痛点集中在以下三类场景:

1. 服务治理碎片化:多服务协同效率低下

电商业务的 “下单 - 支付 - 物流” 全链路涉及 8 个以上微服务,传统治理方案缺乏全局管控能力:

- 链路追踪缺失:某用户反馈 “支付成功但订单状态未更新”,运维团队需逐一登录订单服务、支付服务、消息服务服务器查看日志,耗时 3 小时才发现 “支付服务回调消息未送达消息队列”,期间超 200 笔订单状态异常;

- 流量控制失效:618 大促期间,商品详情页 QPS 从日常 1000 次 / 秒骤增至 12000 次 / 秒,未做流量限制导致商品服务 CPU 使用率飙升至 95%,进而引发订单服务调用超时,订单提交成功率从 99% 降至 75%;

- 故障蔓延风险:第三方支付接口临时宕机,支付服务未配置熔断策略,持续发起无效调用(每秒重试 100 次),导致支付服务线程池耗尽,影响用户登录、商品查询等无关业务,故障影响范围扩大 3 倍。

这类问题的根源在于 “治理逻辑与业务代码耦合”—— 每个服务需单独集成链路追踪、熔断降级组件,50 个服务需重复开发适配代码,且配置规则分散在各服务,无法统一管控。

2. 框架性能瓶颈:高并发场景支撑不足

Spring Boot2.x 作为早期微服务基础框架,在电商高并发场景下暴露出明显性能短板:

- 启动与部署效率低:单个服务启动时间从 10 秒增至 35 秒,50 个服务全量重启需 40 分钟,大促前紧急修复 bug 时,因部署耗时过长错过最佳上线窗口;

- 内存与并发瓶颈:每个服务 JVM 内存占用超 512MB,50 个服务总内存消耗达 28GB,服务器资源成本高;且在每秒 8000 次订单请求下,接口响应时间从 50ms 增至 550ms,远超用户可接受的 100ms 阈值,导致用户流失率上升 15%;

- JDK 特性支持滞后:无法利用 JDK17 的虚拟线程、ZGC 垃圾收集器等新特性,多线程并发处理能力弱,订单创建接口在峰值时段频繁出现 “线程池满” 错误。

3. 云原生适配滞后:容器化部署效率低

ZKmall 将服务迁移至 Kubernetes 容器平台后,传统架构与云原生生态的适配矛盾凸显:

- 镜像与部署效率差:Spring Boot2.x 服务镜像体积超 850MB,镜像拉取时间达 4 分钟,Kubernetes 滚动更新 50 个服务需 30 分钟,期间服务可用性下降;

- 监控与运维脱节:无法直接对接 Prometheus、Grafana 等云原生监控工具,需开发自定义适配插件采集服务指标,监控数据延迟超 8 分钟,大促期间无法及时发现性能异常;

- 服务网格集成难:Spring Cloud Netflix 与 Istio 服务网格兼容性差,无法实现 “零侵入治理”,多技术栈并存导致架构复杂度提升,运维团队学习成本增加。

二、服务网格实践:Istio 驱动的 “零侵入” 服务治理

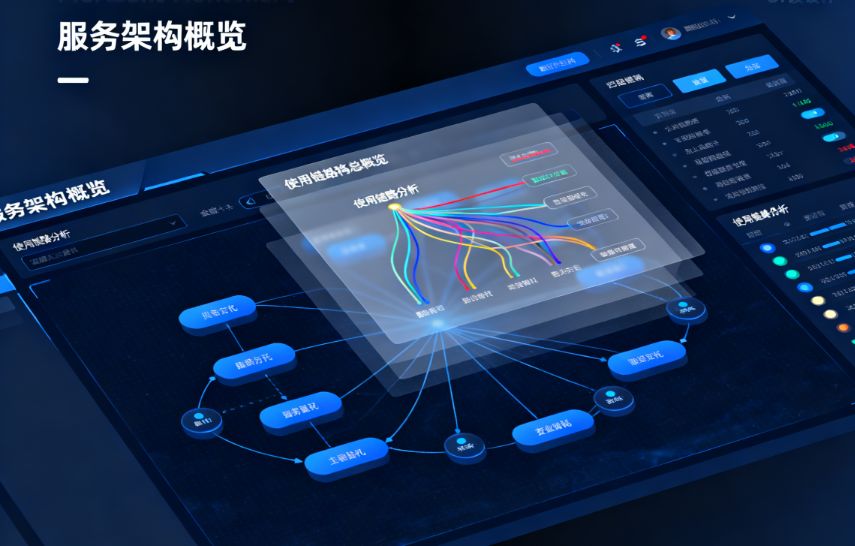

ZKmall 选择 Istio 作为服务网格核心框架,构建 “数据平面 + 控制平面” 分离式架构,将链路追踪、流量控制、故障容错等治理逻辑从业务服务中剥离,实现 50 个微服务的 “零代码改造” 接入。

1. 架构分层设计:数据平面与控制平面协同

- 数据平面(Sidecar 代理):每个微服务容器旁部署 Istio Proxy(基于 Envoy),所有服务调用流量均通过 Sidecar 转发:

- 流量拦截:自动拦截 HTTP/gRPC 调用,无需业务服务修改端口或协议;

- 数据采集:实时记录调用源、目标服务、响应时间、错误码等数据,生成全局唯一 traceId;

- 策略执行:执行控制平面下发的流量限制、熔断降级规则,如商品服务 QPS 超 8000 次 / 秒时自动限流;

- Pilot:将治理规则转化为 Sidecar 可执行配置,如将 “订单服务调用支付服务超时时间设为 500ms” 同步至所有 Sidecar;

- Citadel:自动生成服务证书,实现服务间 TLS 加密通信,防止数据传输泄露;

- Kiali:提供可视化服务拓扑图,直观展示 “用户服务→订单服务→支付服务” 的调用关系与流量占比。

案例:接入 Istio 后,ZKmall 的商品服务无需修改代码,即可通过 Sidecar 实现 “流量限流 + 链路追踪”,开发团队专注于商品搜索算法优化,新功能上线周期从 2 周缩短至 5 天。

2. 核心治理能力落地:解决电商业务痛点

(1)全链路可观测:故障排查效率提升 90%

结合 Jaeger 链路追踪工具,实现服务调用轨迹可视化:

- 链路采集:Sidecar 自动关联 “用户下单” 全链路的 traceId,从 “用户点击下单” 到 “物流信息推送” 的 8 个服务调用环节均被记录;

- 异常定位:在 Kiali 控制台输入异常订单号,可快速定位故障环节,如 “支付服务调用第三方接口超时 3000ms”,并显示超时原因(第三方接口返回 503 错误);

- 日志聚合:将各服务日志统一存储至 ELK 平台,通过 traceId 关联查询,避免逐一登录服务器查看日志。

效果:故障排查时间从 3 小时缩短至 15 分钟,618 大促期间订单异常率从 5% 降至 0.5%,用户投诉量减少 80%。

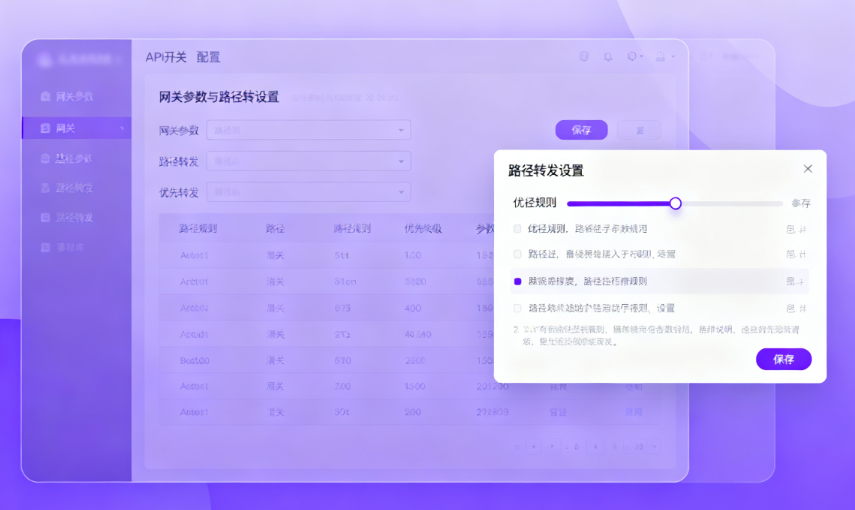

(2)精细化流量控制:大促期间服务稳定性提升

针对电商大促 “流量突发、版本迭代频繁” 特性,实现多维度流量管控:

- 限流防护:为商品详情页接口设置 QPS 阈值 8000 次 / 秒,流量超限时返回 “排队提示”,避免服务过载;同时对爬虫 IP 设置 QPS 上限 100 次 / 秒,保障正常用户访问;

- 灰度发布:新版本订单服务上线时,通过 Istio 将 10% 流量路由至新版本,90% 流量保留在旧版本,若新版本出现错误率超 1%,则一键切回旧版本;

- 故障隔离:第三方物流接口不可用时,Sidecar 自动触发熔断(错误率超 5% 时),后续请求直接返回 “物流查询中”,避免物流服务线程池耗尽影响订单创建。

案例:双 11 大促期间,商品服务峰值 QPS 达 15000 次 / 秒,Sidecar 成功拦截 7000 次 / 秒超额流量,服务响应时间稳定在 80ms 以内,订单提交成功率达 99.9%。

(3)服务通信安全:全链路 TLS 加密

通过 Citadel 组件实现服务间通信安全:

- 证书管理:自动为每个服务生成 TLS 证书(有效期 1 天),每日凌晨自动轮换,避免证书过期风险;

- 访问控制:配置 “仅允许订单服务调用支付服务”“禁止外部服务访问用户服务” 等策略,Sidecar 严格拦截非法调用;

- 合规审计:记录所有服务通信日志,包含调用时间、证书信息,满足《数据安全法》对跨境电商数据传输的合规要求。

效果:服务通信安全事件发生率从每月 5 起降至 0 起,用户支付信息泄露风险为 0,通过 PCI DSS 支付卡行业安全认证。

三、Spring Boot3 升级:微服务基础架构现代化

在服务网格重构治理体系的同时,ZKmall 完成 Spring Boot3 升级,充分利用 JDK17 新特性与框架优化,解决传统架构的性能与云原生适配问题。

1. 性能优化:启动、内存、并发全面提升

- 采用 JDK17 模块系统与 Spring Boot3 自动配置优化,单个服务启动时间从 35 秒缩短至 12 秒,50 个服务全量启动时间从 40 分钟降至 10 分钟;

- 支持分层 JAR(Layered JAR),容器部署时仅更新业务代码层(占镜像体积 20%),服务更新时间从 5 分钟缩短至 1 分钟;

- 优化 JVM 内存模型,结合按需加载机制,单个服务 JVM 内存从 512MB 降至 280MB,50 个服务总内存从 28GB 降至 14GB,服务器资源成本降低 45%;

- 启用 ZGC 垃圾收集器,GC 停顿时间从 100ms 缩短至 1ms 以内,避免大促期间因 GC 停顿导致的接口延迟;

- 支持 JDK17 虚拟线程,通过@Async注解即可使用,线程创建成本降低 99%,订单创建接口并发处理能力从 5000 次 / 秒提升至 12000 次 / 秒;

- 优化内置 Tomcat 服务器,支持 HTTP/2 与异步 IO,接口响应时间从 550ms 缩短至 80ms,用户页面加载速度提升 75%。

案例:双 11 期间,订单服务峰值 QPS 达 12000 次 / 秒,基于 Spring Boot3 的服务仍保持 80ms 响应时间,未出现任何性能瓶颈,订单处理量较去年增长 180%。

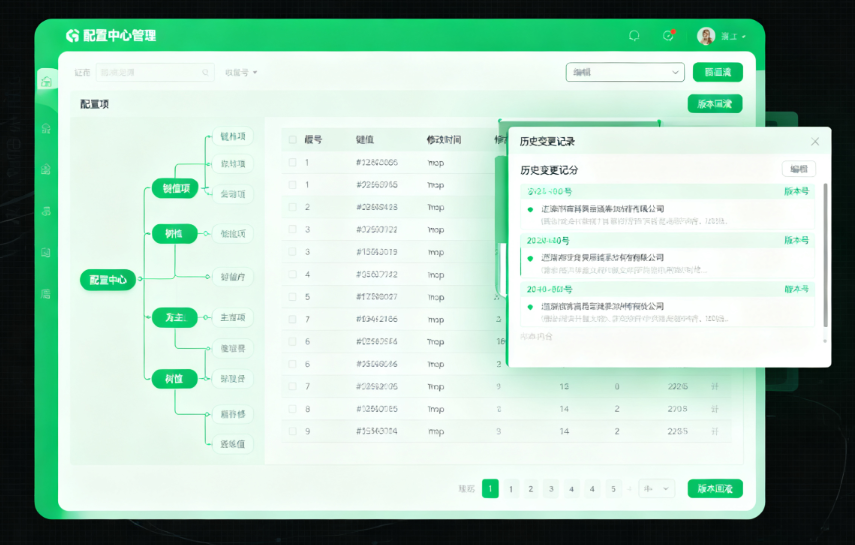

2. 云原生适配:无缝融入 Kubernetes 生态

- 通过 jlink 工具裁剪 JDK,服务镜像体积从 850MB 降至 300MB,镜像拉取时间从 4 分钟缩短至 30 秒;

- 内置 Kubernetes 配置客户端,直接读取 ConfigMap/Secret 配置,无需依赖外部配置中心,部署复杂度降低 60%;

- 集成 Micrometer 1.12+,直接对接 Prometheus/Grafana,监控数据延迟从 8 分钟缩短至 10 秒;

- 新增启动探针(startup probe),适配慢启动服务(如数据初始化服务),避免 Kubernetes 误杀未完全启动的服务;

- Spring Boot3 自动识别 Istio Sidecar,无需修改配置即可实现流量转发,与服务网格协同效率提升 80%;

- 支持云原生服务发现,通过 Kubernetes Service 或 Istio VirtualService 实现服务注册发现,替代传统 Eureka,减少中间件依赖。

3. 安全增强:合规与防护能力升级

- 全局启用 HTTPS,自动生成开发环境自签名证书,生产环境支持 SSL 证书自动配置,避免 HTTP 明文传输风险;

- 集成 TLS 1.3 协议,关闭弱加密算法(TLS 1.0/1.1),符合欧盟 GDPR 与支付卡 PCI DSS 合规要求;

- 内置敏感数据脱敏组件,日志中的手机号、银行卡号自动替换为 “1388888”“ **** **** 1234”;

- 升级 Spring Security 6.x,支持 OAuth2.1 与 OpenID Connect 1.0,强化用户登录与第三方接口调用安全;

- 自动记录用户登录、订单支付、权限变更等操作日志,包含操作人、IP 地址、时间戳,日志存储在区块链节点(FISCO BCOS),不可篡改,满足《个人信息保护法》审计要求。

四、技术协同价值:服务网格与 Spring Boot3 的 1+1>2 效果

ZKmall 的服务网格实践与 Spring Boot3 升级并非独立进行,而是通过技术协同形成 “治理智能化 + 基础架构现代化” 的双重优势,为业务带来显著价值:

1. 开发效率提升 80%

- 服务网格实现治理逻辑零侵入,50 个微服务无需修改代码即可接入链路追踪、流量控制,开发团队专注业务逻辑,新功能上线周期从 2 周缩短至 3 天;

- Spring Boot3 简化配置与部署,分层 JAR 与 Kubernetes 原生适配,服务迭代频率从每月 2 次提升至每周 3 次,快速响应业务需求(如临时促销活动)。

2. 运维成本降低 55%

- 服务网格的全链路可观测与智能告警,结合 Spring Boot3 的云原生监控,运维人员排查故障时间从 3 小时缩短至 15 分钟,运维人力成本降低 40%;

- 内存占用降低 45% 与服务器资源优化,硬件成本每年减少 120 万元;镜像体积缩小 65%,容器仓库存储成本降低 50%。

3. 系统稳定性与业务增长双提升

- 大促期间服务可用性从 99.5% 提升至 99.99%,订单提交成功率从 75% 提升至 99.9%,用户流失率下降 15%;

- 并发处理能力翻倍,支撑 ZKmall 商户数量从 500 家扩展至 1500 家,日均订单量从 5 万单增长至 18 万单,业务规模实现 260% 增长。

微服务创新是电商业务增长的 “技术引擎”

ZKmall 的实践证明,服务网格与 Spring Boot3 的协同升级,不仅解决了传统微服务架构的治理、性能、云原生适配痛点,更成为业务增长的 “技术引擎”—— 通过零侵入治理释放开发效率,通过性能优化支撑高并发场景,通过云原生适配降低运维成本。

未来,ZKmall 将进一步深化微服务创新,例如引入 AI 智能流量调度(基于实时业务数据动态调整流量权重)、Service Mesh 与 Serverless 结合(按需弹性伸缩,进一步降低资源成本),持续提升微服务架构的智能化与精细化水平,为电商业务的持续增长保驾护航。