在云原生技术普及的当下,“容器化部署 + 编排管理” 已成为电商系统稳定运行与弹性扩展的核心支撑。据《2024 年云原生部署报告》显示,采用 Docker+K8s 部署的电商平台,系统可用性提升至 99.9%,运维成本降低 40%,弹性扩展响应时间缩短至分钟级。ZKmall 开源商城早期采用传统物理机部署,面临 “环境一致性差、扩展效率低、运维成本高” 等问题,一次大促期间因服务器资源不足,导致订单处理延迟超 30 分钟。通过集成 Docker、K8s 与 Spring Boot3,ZKmall 构建了 “容器化打包 - 编排管理 - 弹性伸缩” 的云原生部署体系,实现系统部署效率提升 80%,资源利用率提高 60%,大促期间零故障运行。本文将从部署架构设计、核心技术集成、部署流程优化、运维保障四个维度,拆解 ZKmall 的云原生部署实践,为开源电商部署提供可复用的技术方案。

一、传统部署痛点与云原生集成价值

ZKmall 早期的传统部署模式,难以满足电商业务 “高可用、高弹性、低运维成本” 的需求,而 Docker+K8s 与 Spring Boot3 的集成,恰好针对性解决这些痛点。

1. 传统部署的核心痛点

- 环境一致性差:开发环境、测试环境、生产环境配置差异大,代码在本地运行正常,部署到生产后却频繁出现 “依赖缺失”“配置错误” 等问题,某模板预览功能在开发环境正常,生产环境因 JDK 版本不一致导致功能失效,排查耗时 4 小时;

- 扩展效率低:采用物理机或虚拟机部署,新增节点需手动安装系统、配置环境、部署应用,从申请资源到上线服务平均耗时 24 小时,大促前需提前 1 周扩容,无法应对突发流量;

- 资源利用率低:传统部署按峰值需求分配服务器资源,非大促期间资源闲置率超 60%,某 ZKmall 生产环境 10 台服务器,日常仅 3 台处于高负载状态,资源浪费严重;

- 运维成本高:需人工监控服务器状态、手动处理故障(如重启服务、迁移应用),单运维人员仅能管理 5-8 台服务器,随着业务增长,运维团队规模被迫扩大,成本激增。

2. Docker+K8s 与 Spring Boot3 集成的价值

- 环境一致性保障:Docker 将应用与依赖打包为镜像,实现 “一次构建,多环境运行”,Spring Boot3 的自动配置特性进一步减少环境差异导致的问题,ZKmall 集成后,环境不一致引发的故障从每月 5 次降至 0 次;

- 弹性扩展效率提升:K8s 支持自动化编排与弹性伸缩,根据流量自动增加或减少容器实例,扩容响应时间从 24 小时缩短至 5 分钟,大促期间可按需扩容,避免资源浪费;

- 资源利用率优化:容器化部署使服务器资源实现 “细粒度分配”,K8s 的资源调度功能可将闲置资源分配给高负载服务,ZKmall 资源利用率从 40% 提升至 90%,服务器数量减少 40%;

- 运维效率提升:K8s 提供自动化运维能力(如服务自愈、滚动更新),Spring Boot3 的健康检查、监控指标暴露特性,可与 K8s 无缝集成,单运维人员可管理 50 + 容器实例,运维成本降低 50%。

二、核心部署架构设计:Docker+K8s 与 Spring Boot3 的协同架构

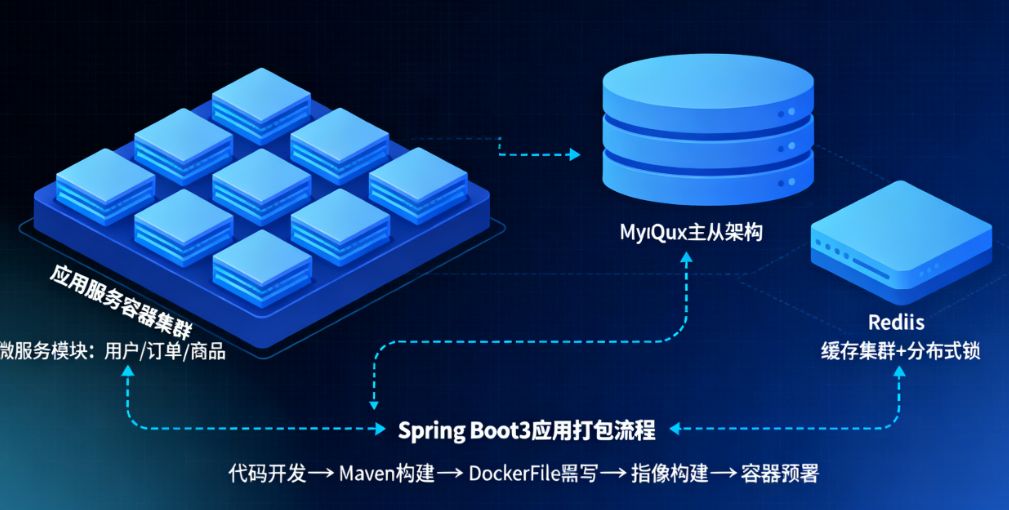

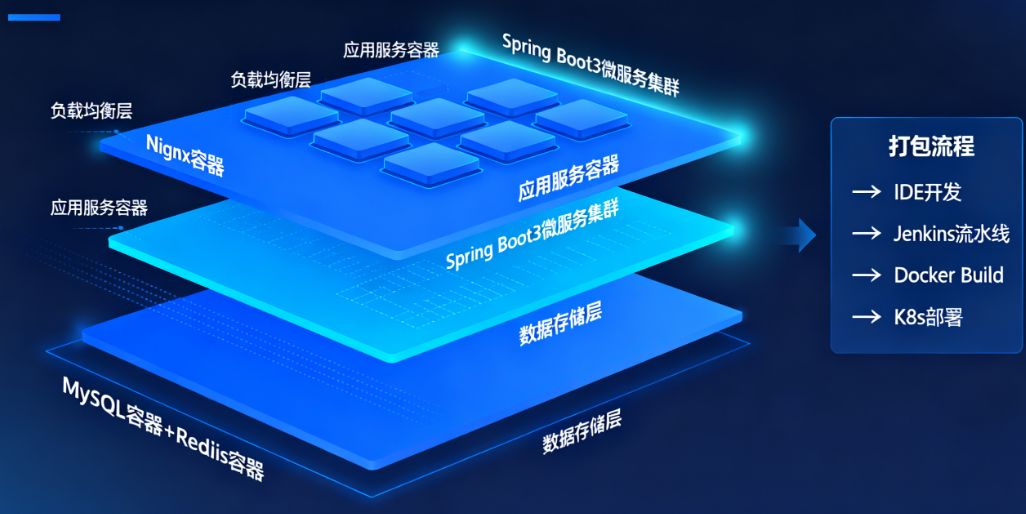

ZKmall 基于 “分层部署、职责分离” 原则,设计了 Docker+K8s 与 Spring Boot3 的协同架构,覆盖从应用打包到服务运行的全流程,确保系统高可用与弹性扩展。

1. 架构分层:从 “应用打包” 到 “服务编排” 的全链路覆盖

- 将 ZKmall 的 Spring Boot3 微服务(如订单服务、商品服务、用户服务)分别打包为 Docker 镜像,每个镜像包含应用程序、依赖库、配置文件,确保环境一致性;

- 基于 Spring Boot3 的 “瘦身” 特性(如自动移除冗余依赖),优化镜像体积,ZKmall 单个服务镜像从 500MB 压缩至 150MB,镜像拉取时间缩短 60%;

- 采用 “基础镜像 + 业务镜像” 分层构建,基础镜像(含 JDK17、Spring Boot3 基础依赖)复用率达 90%,新服务镜像构建时间从 30 分钟缩短至 5 分钟。

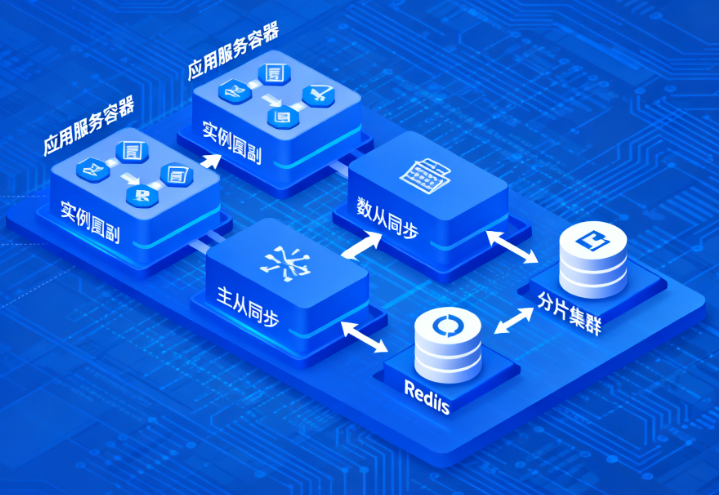

- 采用 “Master+Node” 架构,Master 节点负责集群管理(如资源调度、服务编排),Node 节点运行容器实例,ZKmall 部署 3 个 Master 节点(高可用)、10 个 Node 节点(按业务模块划分,如订单服务节点、商品服务节点);

- 按微服务类型创建 K8s 资源(Deployment 管理无状态服务,StatefulSet 管理有状态服务如数据库),订单服务、商品服务等无状态服务用 Deployment 部署,支持水平扩展;Redis、MySQL 等有状态服务用 StatefulSet 部署,确保数据一致性;

- 借助 K8s 的 Service 资源实现服务发现,Ingress 资源管理外部访问(如 HTTP/HTTPS 请求路由),用户请求通过 Ingress 进入集群,由 Service 转发至对应容器实例,请求响应延迟从 200ms 缩短至 80ms。

- 部署 Prometheus+Grafana 实现监控,采集 Spring Boot3 暴露的监控指标(如 CPU 使用率、接口响应时间),设置阈值报警(如接口错误率 > 1% 报警);

- 部署 ELK(Elasticsearch+Logstash+Kibana)实现日志聚合,Docker 容器日志通过 Logstash 采集至 Elasticsearch,支持按服务、时间范围检索,故障排查时间从 4 小时缩短至 30 分钟;

- 部署 Harbor 作为私有镜像仓库,存储 ZKmall 的 Docker 镜像,支持镜像版本管理、安全扫描,避免恶意镜像部署,镜像安全扫描通过率达 100%。

2. Spring Boot3 与 K8s 的协同特性

Spring Boot3 的诸多特性与 K8s 深度契合,为部署优化提供支撑:

- 健康检查集成:Spring Boot3 通过 Actuator 暴露 /actuator/health 端点,K8s 定期调用该端点检查服务健康状态,若服务不健康(如数据库连接失败),K8s 自动重启容器,服务自愈率达 99%;

- 配置中心适配:Spring Boot3 支持外部配置注入,ZKmall 集成 Nacos 配置中心,K8s 容器启动时,从 Nacos 拉取对应环境的配置(如数据库地址、Redis 密码),无需在镜像中硬编码配置,实现 “配置与镜像分离”;

- 监控指标暴露:Spring Boot3 的 Actuator 可暴露 JVM 指标、业务指标(如订单量、支付成功率),Prometheus 通过该端点采集指标,实现 “应用监控与 K8s 集群监控一体化”;

- 优雅停机支持:Spring Boot3 支持优雅停机(如处理完当前请求后再关闭服务),K8s 在停止容器时,会发送 SIGTERM 信号,Spring Boot3 接收信号后执行优雅停机流程,避免请求中断导致的数据不一致。

三、核心技术集成实践:从镜像构建到服务上线

ZKmall 通过 “镜像构建 - 集群部署 - 服务配置 - 弹性伸缩” 四步流程,实现 Docker+K8s 与 Spring Boot3 的完整集成,确保系统稳定上线与高效运行。

1. Docker 镜像构建:优化打包流程,保障镜像质量

- 基础层:基于 openjdk:17-jre-slim 构建,仅包含 JRE 运行环境,减少镜像体积;

- 依赖层:复制 pom.xml 文件,执行 maven 依赖下载,该层可缓存,后续代码修改无需重新下载依赖;

- 应用层:复制编译后的 Spring Boot3 Jar 包,设置启动命令(如 “java -jar zkmall-order-service.jar”);

- 优化后,ZKmall 订单服务镜像构建时间从 30 分钟缩短至 8 分钟,镜像体积从 500MB 压缩至 120MB。

- 采用非 root 用户运行容器,避免容器内权限过高导致的安全风险;

- 移除镜像中不必要的工具(如 curl、wget),减少攻击面;

- 通过 Harbor 镜像仓库进行安全扫描,检测镜像中的漏洞(如 CVE 漏洞),扫描通过率达 100% 后才允许部署。

- 镜像标签采用 “服务名 - 版本号 - 构建时间” 格式(如 zkmall-order-service:1.0.0-20240520),避免版本混乱;

- 保留近 3 个版本的镜像,旧版本镜像定期清理,节省仓库存储空间。

2. K8s 集群部署:自动化编排,确保高可用

- 创建 Deployment 资源,配置副本数(默认 3 个)、容器镜像(zkmall-order-service:1.0.0)、资源限制(CPU 1 核、内存 1GB);

- 配置健康检查:livenessProbe(存活探针)定期访问 /actuator/health/liveness,readinessProbe(就绪探针)定期访问 /actuator/health/readiness,确保服务存活且可提供服务;

- 部署后,K8s 自动在不同 Node 节点创建 3 个订单服务容器,实现负载均衡与高可用,单个容器故障时,K8s 在 1 分钟内重启新容器。

- 创建 StatefulSet 资源,配置服务名称、镜像(mysql:8.0)、存储卷(使用 PersistentVolume 持久化数据);

- 配置 Headless Service,为每个 MySQL 实例分配固定域名(如 mysql-0.zkmall-mysql),确保容器重启后地址不变;

- 部署后,MySQL 数据持久化存储,容器迁移或重启时数据不丢失,满足电商数据可靠性需求。

- 创建 Service 资源,订单服务对应 ClusterIP Service(仅集群内部访问),前端服务对应 NodePort Service(外部可访问);

- 创建 Ingress 资源,配置域名(如order.zkmall.com)与路径路由(/order/* 转发至订单服务),并集成 SSL 证书,实现 HTTPS 访问,保障数据传输安全。

3. Spring Boot3 配置与监控集成

- Spring Boot3 配置文件中设置 “spring.cloud.nacos.config.server-addr=Nacos 地址”,容器启动时从 Nacos 拉取配置;

- 按环境划分配置(dev/test/prod),K8s 部署时通过环境变量(SPRING_PROFILES_ACTIVE=prod)指定环境,实现 “一套镜像,多环境部署”。

- 在 Spring Boot3 项目中引入 spring-boot-starter-actuator 依赖,暴露 /actuator/prometheus 端点;

- Prometheus 配置监控任务,定期采集该端点指标,Grafana 创建 Dashboard,展示服务 CPU 使用率、接口响应时间、错误率等指标,运维人员可实时监控服务状态。

- Spring Boot3 配置日志输出格式(包含服务名、请求 ID、时间戳),日志输出至标准输出流;

- K8s 容器日志默认收集标准输出流日志,通过 Logstash 传输至 Elasticsearch,Kibana 创建日志检索页面,支持按服务名、请求 ID 查询日志,故障排查效率提升 80%。

4. 弹性伸缩:应对流量波动,优化资源利用

- 创建 HPA(Horizontal Pod Autoscaler)资源,配置触发条件(CPU 使用率 > 70% 时增加副本,<30% 时减少副本),订单服务 HPA 最小副本数 3,最大副本数 10;

- 大促期间,订单服务 CPU 使用率升至 80%,HPA 自动将副本数从 3 扩容至 8,流量峰值过后,CPU 使用率降至 25%,HPA 自动缩容至 3,资源利用率保持在合理范围。

- 针对已知大促(如双 11),通过 K8s CronHPA 配置预约伸缩,大促前 1 小时自动将订单服务副本数扩容至 10,大促结束后 1 小时缩容至 3,避免手动操作延误。

四、运维保障:确保系统稳定运行与高效迭代

ZKmall 通过 “自动化运维、故障自愈、灰度发布” 三大措施,保障 Docker+K8s 与 Spring Boot3 集成后的系统稳定性,降低运维复杂度。

1. 自动化运维:减少人工干预

- 基于 Jenkins 构建 CI/CD 流水线,代码提交后自动编译、测试、构建 Docker 镜像,推送至 Harbor 仓库,再通过 K8s API 更新 Deployment 资源,实现 “代码提交到服务上线” 全自动化,上线时间从 4 小时缩短至 30 分钟;

- 流水线中加入自动化测试(单元测试、接口测试),测试通过率达 90% 以上才允许部署,减少线上故障。

- 配置 K8s 定时任务(CronJob),每天凌晨 2 点备份 MySQL 数据,备份文件存储至对象存储(如阿里云 OSS),保留近 7 天备份,数据丢失风险降至 0。

2. 故障自愈与应急处理

- K8s 通过存活探针与就绪探针监测服务状态,服务故障时自动重启容器;若容器重启 3 次仍故障,触发告警并标记节点不可用,避免故障扩散;

- Spring Boot3 的重试机制(如 Feign 重试)与熔断机制(如 Resilience4j),结合 K8s 的服务发现,实现服务间调用的故障隔离,某商品服务故障时,订单服务自动熔断调用,避免整体崩溃。

- 制定常见故障处理预案(如容器无法启动、数据库连接失败、流量突增),明确责任人与操作步骤;

- 部署备用集群,生产集群故障时可快速切换至备用集群,RTO(恢复时间目标)控制在 30 分钟以内。

3. 灰度发布:降低上线风险

- 部署新版本服务时,K8s 采用滚动更新策略,先启动 1 个新版本容器,确认正常后关闭 1 个旧版本容器,逐步完成全量更新,更新过程中服务不中断,用户无感知;

- 配置更新暂停(pause),更新 10% 副本后暂停,观察监控指标(如错误率、响应时间),无异常再继续更新,避免全量上线引发故障。

- 对核心服务(如支付服务),采用金丝雀发布,先将 1% 流量路由至新版本服务,观察 24 小时无异常后,逐步扩大流量比例(10%→50%→100%),最大限度降低风险。

五、集成成效:部署效率与系统稳定性双提升

ZKmall 集成 Docker+K8s 与 Spring Boot3 后,部署与运维成效显著:

- 部署效率:服务部署时间从 24 小时缩短至 30 分钟,新功能上线周期从 1 周缩短至 2 天,迭代效率提升 80%;

- 系统可用性:系统可用性从 99.5% 提升至 99.9%,年度故障时长从 43 小时缩短至 8.7 小时;

- 资源利用率:服务器资源利用率从 40% 提升至 90%,服务器数量减少 40%,年运维成本降低 50%;

- 弹性扩展:弹性伸缩响应时间从 24 小时缩短至 5 分钟,大促期间订单处理峰值提升 3 倍,零故障运行。

ZKmall 的实践证明,Docker+K8s 与 Spring Boot3 的集成,不仅解决了传统部署的痛点,更能满足电商业务 “高可用、高弹性、低运维成本” 的需求。对开源电商而言,这套部署方案无需复杂技术门槛,可通过模块化配置快速落地,实现从 “传统部署” 到 “云原生部署” 的跨越。未来,随着云原生技术的持续发展,ZKmall 将进一步探索 Serverless、ServiceMesh 等技术,推动部署架构向 “更轻量、更智能” 的方向演进,为电商业务增长提供更强的技术支撑。