在电商领域,系统性能直接关系到用户体验和业务能否持续运转。秒杀活动时瞬间涌入的巨大流量、促销高峰的订单洪流、日常频繁的商品查询,都对系统的承载能力提出了极高要求。ZKmall 开源商城作为面向中大型电商业务的解决方案,通过 “负载均衡分流 + 多级缓存提速” 的组合策略,构建出能支撑高并发、低延迟的高性能架构。其中,负载均衡负责把流量合理分配到各个集群节点,避免单个节点过载;Redis 缓存则通过数据预热、分层存储和失效控制,减轻数据库压力并加快响应速度。本文将深入解析这两大核心策略的设计逻辑、实现方式和实践价值,为高性能电商系统的搭建提供可复用的技术方案。

负载均衡:流量分流的智能调度机制

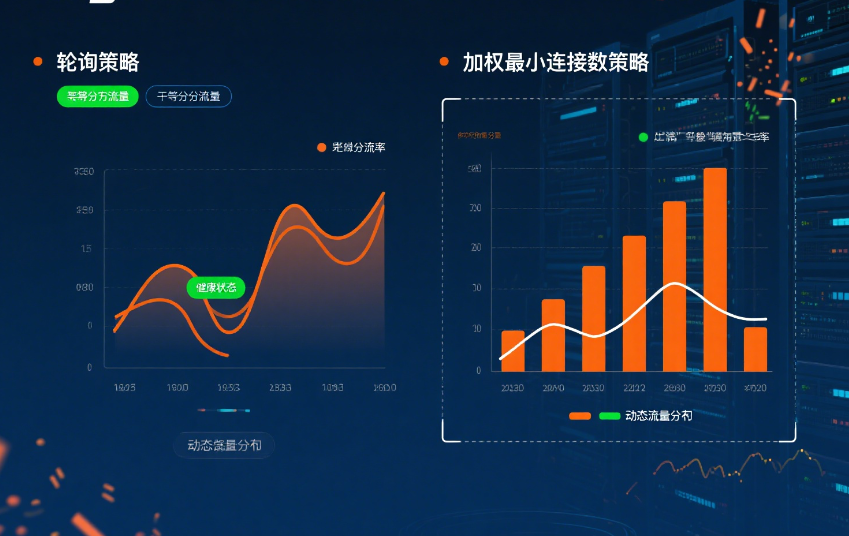

电商系统的流量具有 “突发性” 和 “不均衡性” 特点,比如秒杀活动的流量可能是日常的 100 倍。负载均衡通过动态分配请求,确保每个服务器节点的负载处于合理范围,是系统顶住高峰流量的第一道防线。ZKmall 采用 “多级负载均衡 + 智能调度策略”,实现从接入层到服务层的全链路流量优化。

接入层负载均衡解决了入口流量分配的问题。ZKmall 在接入层部署了 Nginx 集群作为反向代理,通过 “四层 + 七层” 的混合模式处理请求:TCP 四层负载均衡基于 IP 和端口对 TCP 连接进行初始分配,把来自不同客户端的连接分发到不同的 Nginx 节点,防止单个节点连接数过多;HTTP 七层负载均衡则根据请求内容,像 URL、Cookie、用户 Agent 等进行精细化路由,例如把 “/api/seckill”(秒杀接口)的请求优先分配到性能更强的应用服务器,把静态资源请求如图片、CSS 直接路由到 CDN 节点。Nginx 采用 “加权轮询” 作为默认调度算法,为配置更高的服务器节点分配更高权重,比如 8 核 16G 服务器权重设为 5,4 核 8G 服务器权重设为 2,这样能让资源利用率达到最大化。一家服饰电商通过接入层优化,在秒杀活动期间,入口流量处理能力提升了 3 倍,Nginx 节点的平均负载从 80% 降到了 40%。

服务层负载均衡实现了微服务间的高效通信。在微服务架构中,服务之间的调用,比如订单服务调用库存服务,也需要负载均衡,避免依赖服务的单点故障影响整个链路。ZKmall 采用 “服务注册中心 + 客户端负载均衡” 模式:所有服务实例启动时,会向 Nacos 注册中心注册自己的地址和健康状态;调用方通过 Feign 客户端从注册中心获取服务实例列表,基于内置的负载均衡算法(默认采用 “最小响应时间”)选择最优节点。对于核心服务如支付服务,额外启用 “熔断降级” 机制(基于 Resilience4j),当某个实例的错误率超过阈值(比如 50%)时,会自动把它从可用列表中剔除,直到恢复正常。某 3C 电商的实践表明,服务层负载均衡让跨服务调用的成功率提升到 99.9%,故障隔离时间缩短到 10 秒级。

动态扩缩容和流量预测应对了弹性需求。负载均衡的静态配置很难应对电商的流量波动,ZKmall 结合 Kubernetes 容器编排实现动态调整:通过监控服务器的 CPU 使用率、内存占用、请求响应时间等指标,当指标超过预设阈值,比如 CPU 使用率持续 5 分钟超过 70% 时,会自动触发扩容,增加 Pod 实例数量;在流量低谷时则自动缩容,避免资源浪费。为了进一步提高响应速度,系统引入了流量预测模型,基于历史数据,如近 30 天的每日流量曲线、促销活动周期等,预测未来 1 小时的流量峰值,提前 30 分钟完成扩容。某生鲜电商在 “618” 期间,通过预测扩容,让系统在流量峰值到来前就完成了资源准备,订单处理延迟控制在 200ms 以内,比没有预测时降低了 60%。

会话保持和分布式追踪平衡了性能和体验。部分电商场景,比如用户结算流程,需要保持会话的连续性,ZKmall 通过 “IP 哈希 + 会话共享” 来实现:对于需要会话保持的请求,如包含 JSESSIONID 的请求,采用 IP 哈希算法把同一客户端的请求分配到同一服务器;同时使用 Redis 存储分布式会话,确保用户在服务器节点切换时会话不会中断。为了方便排查问题,系统集成了 SkyWalking 全链路追踪工具,记录每个请求经过的负载均衡节点、服务实例和处理耗时,通过可视化链路图定位负载不均的瓶颈点,比如某节点因网络延迟导致响应缓慢。一家母婴电商通过会话优化,用户结算流程的中断率下降了 80%,全链路问题定位时间从小时级缩短到了分钟级。

Redis 缓存策略:数据加速的分层存储体系

电商系统的性能瓶颈往往出现在数据库层面,高频的商品查询、库存扣减、订单创建等操作,可能导致数据库连接耗尽或查询超时。Redis 作为高性能的内存数据库,通过把热点数据缓存到内存中,大幅减少数据库访问次数,是提升系统响应速度的核心手段。ZKmall 设计了 “多级缓存 + 精细化管理” 的 Redis 策略,覆盖数据存储、更新和失效的全生命周期。

缓存分层和数据分类存储提高了资源利用率。不同类型的电商数据有着不同的访问频率和更新频率,ZKmall 根据 “热数据 - 温数据 - 冷数据” 的特性,在 Redis 中实施分层存储:热数据,如秒杀商品库存、首页轮播图、热门商品详情等,存储在主 Redis 集群,设置较短的过期时间(5 - 10 分钟),并启用持久化(RDB + AOF 混合模式)防止数据丢失;温数据,如用户近期浏览记录、分类商品列表等,存储在从节点,通过读写分离减轻主节点压力;冷数据,如历史订单、低频商品信息等,不进行缓存,直接查询数据库。针对不同数据类型选择最优的数据结构:商品库存用 String 类型,便于进行原子操作;购物车用 Hash 类型,键为用户 ID,字段为商品 ID;商品排行榜用 Sorted Set 类型,支持按销量排序。某家居电商通过分类存储,Redis 内存使用率提升了 40%,数据库查询量下降了 65%。

缓存更新和一致性保障避免了数据失真。缓存与数据库的数据一致性是缓存策略的核心挑战,ZKmall 针对不同业务场景采用了差异化方案:对于读多写少的场景,如商品详情,采用 “Cache - Aside” 模式,读操作先查询缓存,缓存未命中时查询数据库并更新缓存,写操作先更新数据库再删除缓存(而不是直接更新缓存,避免并发脏写);对于写多读少的场景,如库存扣减,采用 “Write - Through” 模式,写操作同时更新数据库和缓存,确保数据实时一致。针对高并发更新场景,如秒杀库存,使用 Redis 的原子操作(如 DECRBY)直接修改缓存,再通过异步任务同步到数据库,避免数据库成为瓶颈。一家食品电商通过一致性策略,缓存与数据库的同步误差控制在 1 秒内,库存超卖率从 2% 降到了 0.1%。

缓存预热和降级策略应对了流量高峰。在促销活动前,大量冷数据突然变成热数据可能导致 “缓存雪崩”,即缓存同时失效,请求全部涌向数据库。ZKmall 通过 “缓存预热” 提前加载数据:活动开始前 1 小时,通过定时任务批量查询即将参与活动的商品信息(如 1000 款促销商品),写入 Redis 并设置合理的过期时间(如 2 小时,覆盖活动周期);预热过程中监控 Redis 内存占用,确保不超过最大阈值(如总内存的 70%)。当 Redis 集群出现故障,如节点宕机、内存溢出时,系统会自动触发降级策略:暂时关闭非核心缓存,如用户浏览记录,优先保障商品详情、库存等核心数据的缓存;对无法从缓存获取的数据,通过数据库读写分离(主库写、从库读)分散压力。某数码电商在 “双 11” 期间,通过缓存预热使活动初期的数据库压力下降了 90%,在 Redis 出现故障时,系统可用性仍保持在 99.9%。

分布式锁和防缓存穿透解决了并发问题。电商的高并发场景,如秒杀下单,可能因缓存失效导致 “缓存穿透”(大量请求查询不存在的数据,直接穿透到数据库)或 “缓存击穿”(热点 Key 失效瞬间,大量请求冲击数据库)。ZKmall 的应对措施包括:针对缓存穿透,采用 “布隆过滤器” 在请求入口过滤不存在的商品 ID,如将所有有效商品 ID 存入布隆过滤器,不存在的 ID 直接返回空;针对缓存击穿,对热点 Key 设置 “互斥锁”(通过 Redis 的 SETNX 命令实现),当缓存失效时,仅允许一个请求查询数据库并更新缓存,其他请求等待重试;针对缓存雪崩,将缓存过期时间设置为随机值,如基础过期时间 + 1 - 5 分钟,避免大量 Key 同时失效。某鞋类电商通过这些措施,秒杀场景的缓存穿透率下降到 0.01%,数据库的突发压力减少了 80%。

负载均衡与 Redis 缓存的协同策略

负载均衡和 Redis 缓存并非孤立存在,两者协同配合能进一步提升性能优化效果。ZKmall 通过 “流量调度与缓存分布的联动”“状态感知与动态调整”,实现了 1 + 1 > 2 的系统性能提升。

缓存节点与应用节点的协同调度减少了跨节点访问。在分布式部署中,应用服务器与 Redis 节点的物理位置可能影响访问延迟,如跨机房访问耗时会增加 50ms。ZKmall 通过 “就近原则” 调度请求:负载均衡器在分配请求时,优先把应用服务器的请求路由到同一机房的 Redis 节点;当某机房 Redis 节点负载过高时,将部分请求导向邻近机房的备用节点,并动态调整负载均衡权重。同时,应用服务器启用本地缓存(如 Caffeine),存储超高频访问数据,如首页导航信息,减少对 Redis 的远程调用。某跨境电商通过机房级协同,Redis 访问延迟从 80ms 降到了 20ms,跨机房数据传输量减少了 60%。

基于缓存命中率的流量分配优化了资源效率。不同应用服务器的本地缓存命中率可能存在差异,如某节点缓存了更多热点商品,ZKmall 通过 “命中率反馈机制” 动态调整负载:每个应用节点定期向负载均衡器上报本地缓存命中率,如 90%;负载均衡器优先将请求分配到命中率高的节点,减少对 Redis 的依赖;当某节点命中率持续低于阈值(如 60%)时,自动减少其流量权重,避免资源浪费。某综合电商通过这种机制,系统整体缓存命中率提升了 15%,Redis 集群的请求量下降了 25%。

故障场景的协同降级保障了核心功能可用。当负载均衡或 Redis 出现局部故障时,两者的协同降级能最大限度减少影响:若某 Redis 节点宕机,负载均衡器自动将指向该节点的应用请求分配到其他 Redis 节点,并触发应用层降级,如暂时关闭商品详情页的评论数显示;若负载均衡节点故障,Redis 集群自动标记关联应用服务器的缓存数据为 “待同步”,避免脏数据扩散。通过故障演练验证,这种协同机制使系统在单点故障时的性能损失控制在 10% 以内,核心交易链路不受影响。

实践效果与性能优化经验

ZKmall 的负载均衡与 Redis 缓存策略已在多个高并发场景中得到验证,其核心经验可为电商系统的性能优化提供参考。

关键性能指标有了显著提升。某快时尚电商应用 ZKmall 架构后,在日常场景下:页面平均加载时间从 1.5 秒缩短到 300ms;数据库 QPS 从 5000 降至 1500;Redis 缓存命中率稳定在 95% 以上。在秒杀场景(10 万用户抢 1 万件商品)中:系统峰值 QPS 达到 5 万,远超优化前的 1 万;订单创建成功率从 80% 提升到 99.5%;服务器平均负载控制在 60% 以下,没有节点宕机。

性能优化的核心经验如下:一是 “预防为主”,通过压测提前发现瓶颈,如用 JMeter 模拟 10 倍日常流量,然后针对性优化,如增加 Redis 集群节点、调整负载均衡算法;二是 “分层负责”,接入层解决流量入口问题,服务层解决内部调用问题,缓存层解决数据访问问题,避免单一策略承担所有压力;三是 “动态适配”,根据业务变化,如新品上线、促销活动等,调整缓存策略与负载权重,避免静态配置跟不上业务发展;四是 “监控先行”,通过 Grafana + Prometheus 实时监控负载均衡节点状态、Redis 内存使用率、缓存命中率等指标,设置阈值告警,如 Redis 内存使用率超 80% 时报警,提前介入处理。

未来的优化方向,ZKmall 计划引入 AI 驱动的智能优化:通过机器学习预测不同商品的缓存热度,动态调整过期时间;基于用户行为分析,提前将用户可能购买的商品数据加载到用户所在区域的 Redis 节点;实现负载均衡算法的自适应调整,如秒杀时自动切换为 “最少连接数” 算法,进一步提升系统的智能化水平。

负载均衡与 Redis 缓存作为电商系统的 “性能双引擎”,其设计的核心在于 “按需分配资源、就近提供数据”。ZKmall 通过精细化的流量调度与分层缓存策略,既解决了高并发下的系统稳定性问题,又通过毫秒级响应提升了用户体验。对于电商企业来说,性能优化是一个持续迭代的过程,只有结合业务特性不断调整策略,才能在流量高峰和日常运营中始终保持系统的高效与稳定。